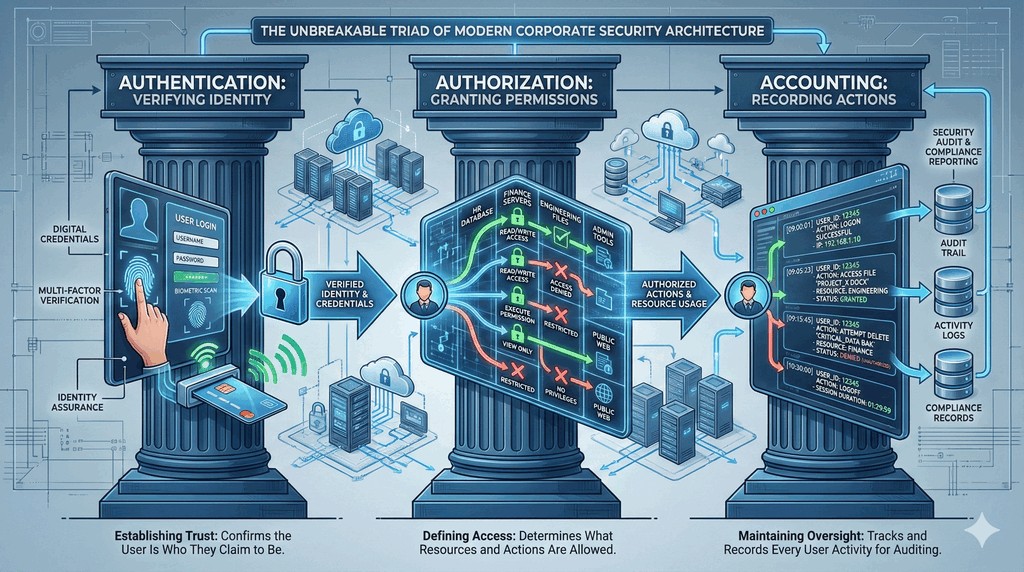

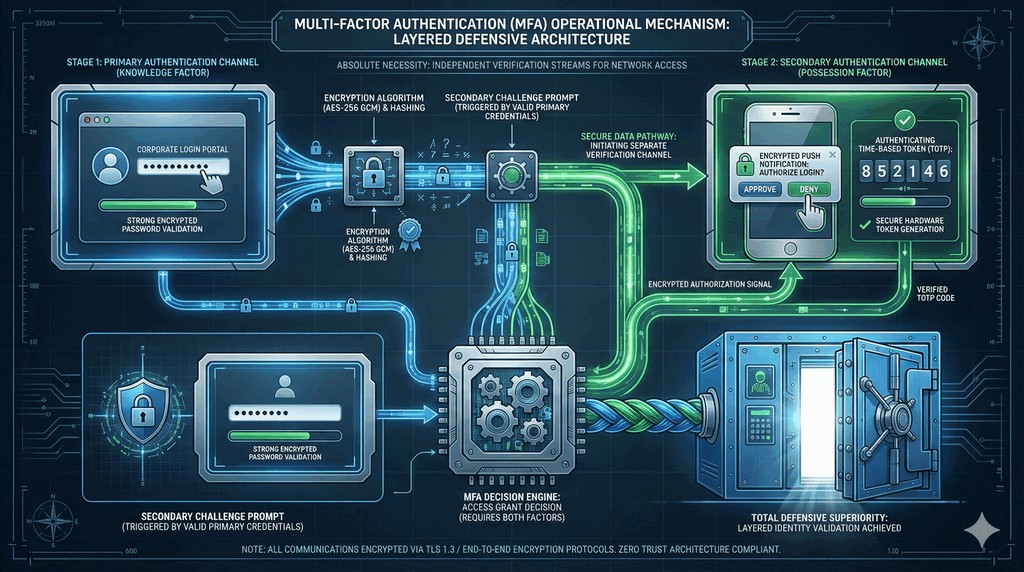

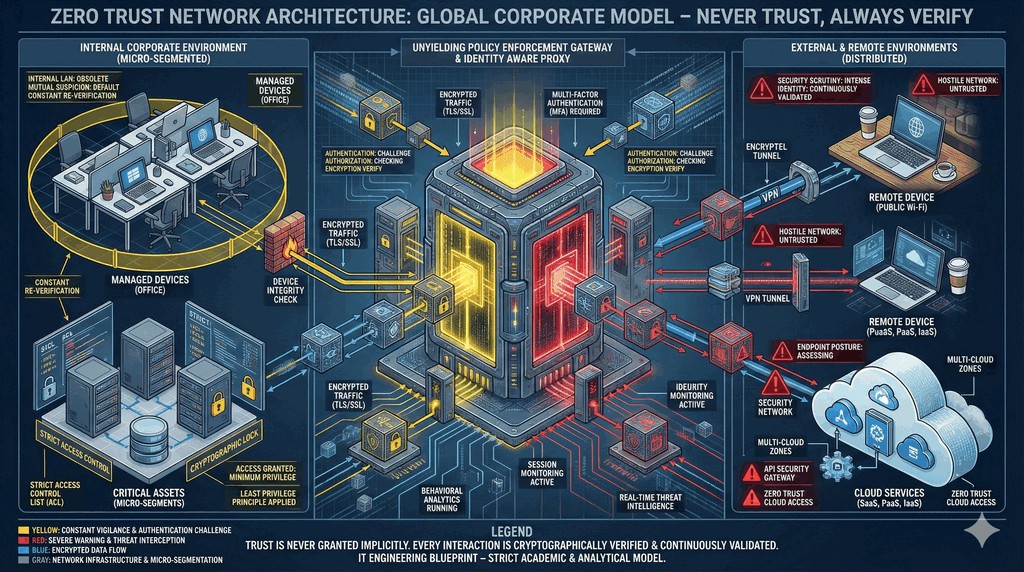

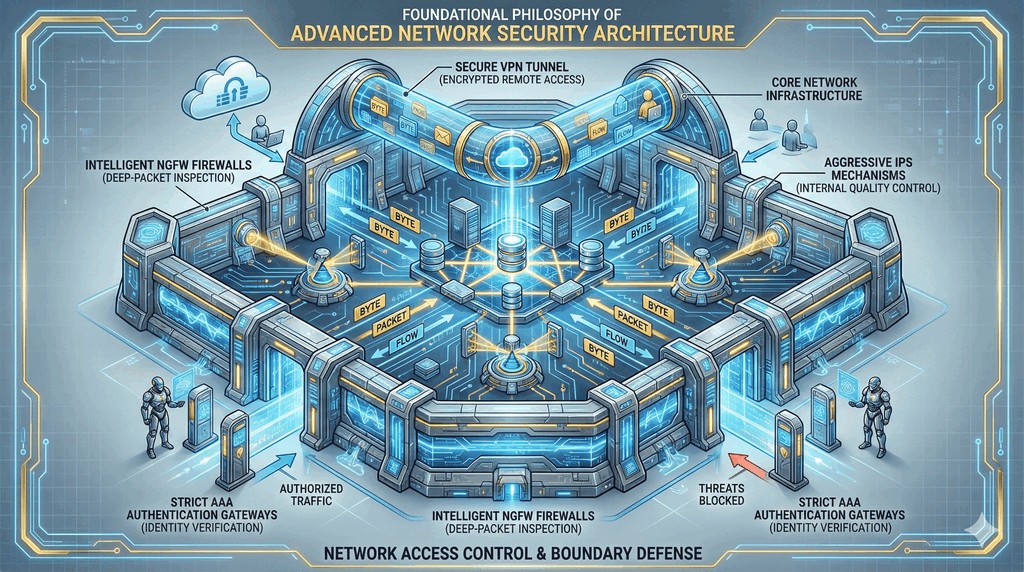

Kontrola dostępu to fundamentalny mechanizm bezpieczeństwa, który decyduje o tym, kto może korzystać z zasobów sieciowych i w jaki sposób. Opiera się on na czterech filarach: identyfikacji, uwierzytelnianiu, autoryzacji i rozliczalności, które razem tworzą spójny system ochrony przed nieautoryzowanym dostępem. Współczesne systemy wykorzystują różnorodne metody, w tym kontrolę dostępu opartą na rolach (RBAC) oraz na atrybutach (ABAC), dostosowując uprawnienia do specyficznych potrzeb organizacji.

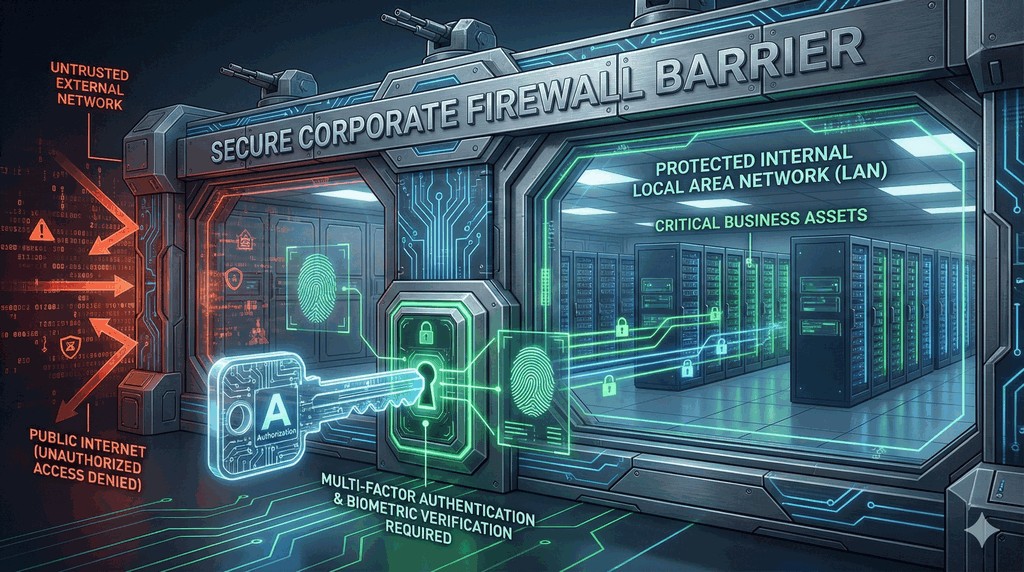

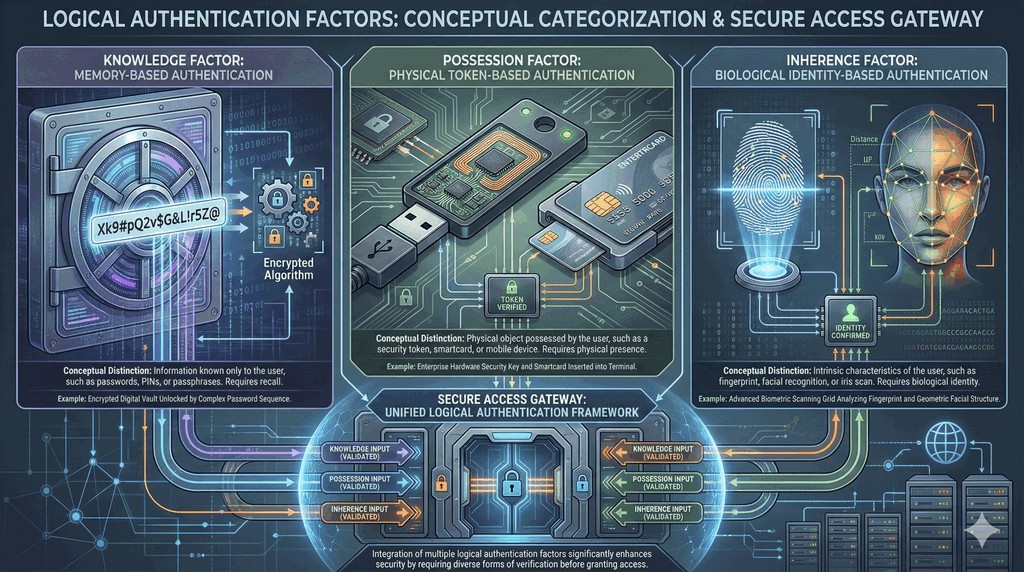

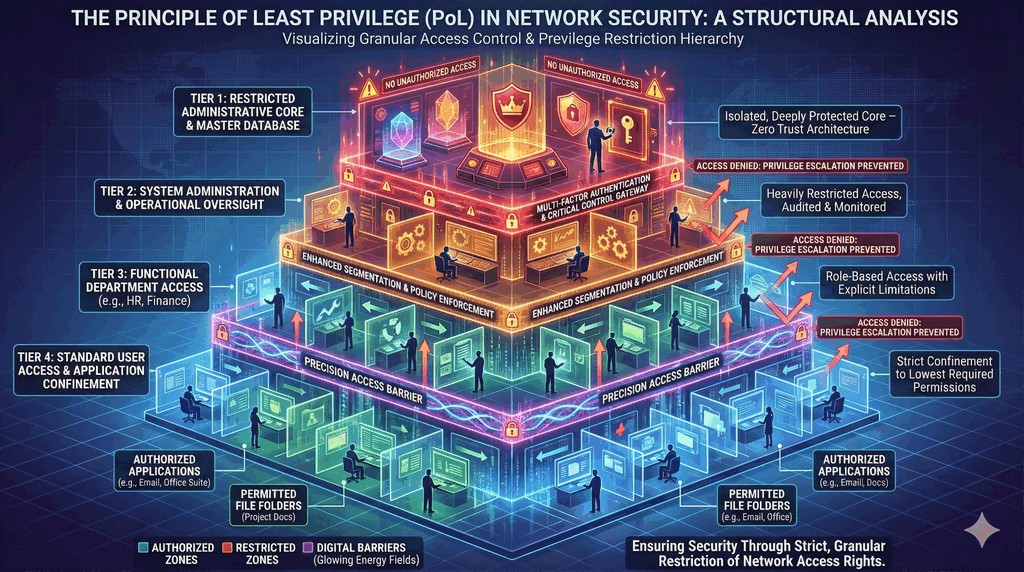

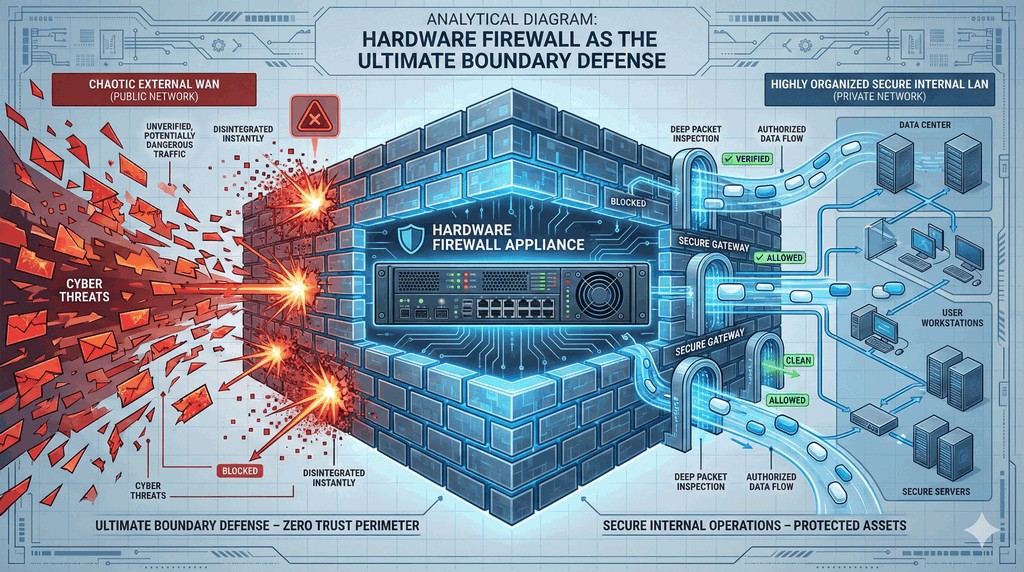

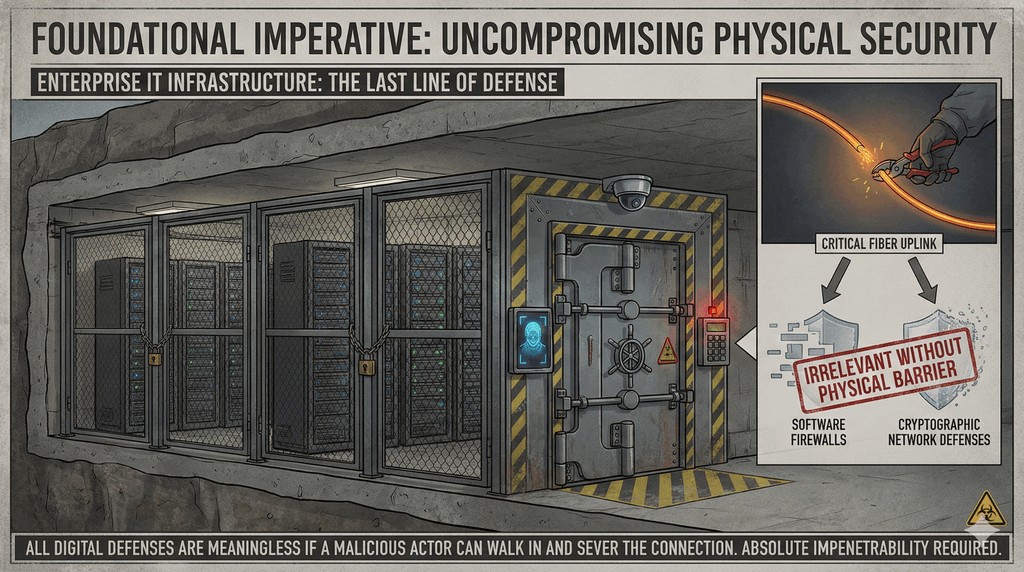

Zasada najmniejszego uprzywilejowania gwarantuje, że użytkownicy otrzymują wyłącznie minimalny zakres uprawnień niezbędny do wykonywania swoich obowiązków. Rozwiązania klasy Network Access Control (NAC) umożliwiają egzekwowanie polityk bezpieczeństwa już na poziomie urządzenia, zanim uzyska ono dostęp do sieci. Fizyczne środki ochrony, takie jak skanery biometryczne i karty zbliżeniowe, stanowią uzupełnienie zabezpieczeń cyfrowych, tworząc wielowarstwową strategię obrony przed intruzami.